Průvodce pro začátečníky ke sběru dat AI

Výběr společnosti pro sběr dat AI pro váš projekt AI / ML

Úvod

Od nynějška kráčíme správnou cestou a s pomocí AI dochází k významným průlomům napříč odvětvími. Pokud vezmete například zdravotní péči, systémy umělé inteligence doprovázené modely strojového učení pomáhají odborníkům lépe porozumět rakovině a navrhnout její léčbu. Neurologické poruchy a obavy, jako je PTSD, se léčí pomocí AI. Vakcíny jsou vyvíjeny rychlým tempem díky klinickým zkouškám a simulacím využívajícím umělou inteligenci.

Nejen zdravotnictví, každé jednotlivé odvětví nebo segment, kterého se AI dotýká, prochází revolucí. Autonomní vozidla, chytré obchody, nositelná zařízení jako FitBit a dokonce i naše fotoaparáty chytrých telefonů jsou schopny zachytit lepší snímky našich tváří pomocí AI.

Díky inovacím, které se dějí v prostoru AI, se společnosti vrhají do spektra s různými případy použití a řešeními. Díky tomu se očekává, že globální trh s umělou inteligencí dosáhne do konce roku 267 tržní hodnoty kolem 2027 miliard USD. Kromě toho přibližně 37 % podniků již implementuje řešení umělé inteligence do svých procesů a produktů.

Ještě zajímavější je, že téměř 77 % produktů a služeb, které dnes používáme, je poháněno umělou inteligencí. Jak se podnikům daří dělat nemožné s umělou inteligencí, protože technologická koncepce výrazně narůstá napříč vertikálami?

Jak nás chatboti přimějí věřit, že mluvíme s jiným člověkem na druhé straně?

Pokud pozorujete odpověď na každou otázku, scvrkává se pouze na jeden prvek – DATA. Data jsou středobodem všech operací a procesů specifických pro umělou inteligenci. Jsou to data, která strojům pomáhají porozumět konceptům, zpracovávat vstupy a poskytovat přesné výsledky.

Všechna hlavní řešení AI, která existují, jsou produkty klíčového procesu, kterému říkáme sběr dat nebo získávání dat nebo trénovací data AI.

Tato obsáhlá příručka vám pomůže pochopit, co to je a proč je to důležité.

Co je sběr dat AI?

Stroje nemají vlastní mysl. Absence tohoto abstraktního konceptu je činí bez názorů, faktů a schopností, jako je uvažování, poznávání a další. Jsou to jen nepohyblivé krabice nebo zařízení zabírající prostor. Chcete-li je přeměnit na výkonná média, potřebujete algoritmy a především data.

Každý jednotlivý produkt nebo řešení s umělou inteligencí, které dnes používáme, a výsledky, které nabízejí, pocházejí z let školení, vývoje a optimalizace. Od zařízení, která nabízejí navigační trasy až po složité systémy, které předpovídají selhání zařízení několik dní předem, každá jednotlivá entita prošla roky školení AI, aby byla schopna poskytovat přesné výsledky.

Sběr dat AI je předběžným krokem v procesu vývoje umělé inteligence, který hned od začátku určuje, jak efektivní a efektivní bude systém umělé inteligence. Právě proces získávání relevantních datových sad z nesčetných zdrojů pomůže modelům umělé inteligence zpracovat detaily lépe a chrlit smysluplné výsledky.

Typy školicích dat AI ve strojovém učení

Nyní je sběr dat AI zastřešujícím pojmem. Data v tomto prostoru mohou znamenat cokoliv. Může se jednat o text, videozáznam, obrázky, zvuk nebo kombinaci všech těchto možností. Stručně řečeno, cokoli, co je užitečné pro stroj k plnění jeho úkolu učení a optimalizace výsledků, jsou data. Chcete-li získat více informací o různých typech dat, uvádíme stručný seznam:

Datové sady mohou pocházet ze strukturovaného nebo nestrukturovaného zdroje. Pro nezasvěcené jsou strukturované datové sady ty, které mají explicitní význam a formát. Jsou snadno srozumitelné pro stroje. Na druhé straně nestrukturované jsou detaily v datových sadách, které jsou všude. Nesledují specifickou strukturu nebo formát a vyžadují lidský zásah, aby z takových datových souborů získaly cenné poznatky.

Textová data

Jedna z nejhojnějších a nejvýznamnějších forem dat. Textová data mohou být strukturována ve formě náhledů z databází, navigačních jednotek GPS, tabulek, lékařských přístrojů, formulářů a dalších. Nestrukturovaný text může být průzkumy, ručně psané dokumenty, obrázky textu, e-mailové odpovědi, komentáře na sociálních sítích a další.

Zvuková data

Zvukové datové sady pomáhají společnostem vyvíjet lepší chatboty a systémy, navrhovat lepší virtuální asistenty a další. Pomáhají také strojům porozumět akcentům a výslovnostem různým způsobům, jak lze položit jednu otázku nebo dotaz.

Obrazová data

Obrázky jsou dalším významným typem datové sady, které se používají pro různé účely. Od samořídících aut a aplikací, jako je Google Lens až po rozpoznání obličeje, obrázky pomáhají systémům přicházet s bezproblémovými řešeními.

Data videa

Videa jsou podrobnější datové sady, které umožňují strojům pochopit něco do hloubky. Soubory video dat pocházejí z počítačového vidění, digitálního zobrazování a dalších.

Jak sbírat data pro strojové učení?

Jak tedy získáváte svá data? Jaká data potřebujete a kolik z nich? Jaké jsou různé zdroje pro získání relevantních dat?

Společnosti posoudí výklenek a účel svých modelů ML a načrtnou potenciální způsoby, jak získat relevantní datové sady. Definování potřebného datového typu řeší hlavní část vašich starostí o získávání dat. Pro lepší představu existují různé kanály, cesty, zdroje nebo média pro sběr dat:

Zdroje zdarma

Jak název napovídá, jedná se o zdroje, které zdarma nabízejí datové sady pro účely školení AI. Volnými zdroji může být cokoli, od veřejných fór, vyhledávačů, databází a adresářů až po vládní portály, které uchovávají archivy informací v průběhu let.

Pokud nechcete vynakládat příliš mnoho úsilí na získávání bezplatných datových sad, existují specializované webové stránky a portály, jako je Kaggle, zdroj AWS, databáze UCI a další, které vám umožní prozkoumat různé

kategorie a stáhněte si zdarma požadované datové sady.

Interní zdroje

Ačkoli se volné zdroje zdají být pohodlnými možnostmi, je s nimi spojeno několik omezení. Za prvé, nemůžete si být vždy jisti, že najdete datové sady, které přesně odpovídají vašim požadavkům. I když se shodují, datové sady mohou být z hlediska časových os irelevantní.

Pokud je váš segment trhu relativně nový nebo neprozkoumaný, nebude zde mnoho kategorií ani relevantních

datové sady, které si můžete také stáhnout. Aby se předešlo předběžným nedostatkům s volnými zdroji, tam

existuje další datový zdroj, který funguje jako kanál pro generování relevantnějších a kontextových datových sad.

Jsou to vaše interní zdroje, jako jsou databáze CRM, formuláře, potenciální zákazníci e-mailového marketingu, kontaktní body definované produktem nebo službou, uživatelská data, data z nositelných zařízení, data webových stránek, tepelné mapy, statistiky sociálních médií a další. Tyto interní zdroje definujete, nastavujete a udržujete vy. Můžete si tedy být jisti jeho důvěryhodností, relevanci a aktuálností.

Placené zdroje

Bez ohledu na to, jak užitečné znějí, vnitřní zdroje mají také svůj spravedlivý podíl na komplikacích a omezeních. Například většina zaměření vašeho talentového fondu bude věnována optimalizaci datových kontaktních bodů. Navíc koordinace mezi vašimi týmy a zdroji musí být také bezvadná.

Abyste se vyhnuli dalším podobným škytavkám, jako jsou tyto, máte placené zdroje. Jsou to služby, které vám nabízejí nejužitečnější a nejkontextuálnější datové sady pro vaše projekty a zajišťují, že je budete mít neustále, kdykoli budete potřebovat.

První dojem, který má většina z nás na placené zdroje nebo dodavatele dat, je, že jsou drahé. Nicméně,

když si to spočítáte, jsou levné jen z dlouhodobého hlediska. Díky jejich rozsáhlým sítím a metodologiím získávání dat budete moci přijímat komplexní datové sady pro své projekty AI bez ohledu na to, jak nepravděpodobné jsou.

Abychom vám poskytli podrobný přehled rozdílů mezi těmito třemi zdroji, zde je podrobná tabulka:

| Volný Zdroje | Interní zdroje | Placené zdroje |

|---|---|---|

| Datové sady jsou k dispozici zdarma. | Interní zdroje mohou být také zdarma v závislosti na vašich provozních nákladech. | Platíte dodavateli dat, aby pro vás získal relevantní datové sady. |

| Více bezplatných zdrojů dostupných online ke stažení preferovaných datových sad. | Získáte uživatelsky definovaná data podle vašich potřeb pro školení AI. | Získáváte uživatelsky definovaná data konzistentně tak dlouho, jak budete potřebovat. |

| Na kompilaci, správě, formátování a anotování datových sad musíte pracovat ručně. | Můžete dokonce upravit své datové dotykové body a generovat datové sady s požadovanými informacemi. | Datové sady od dodavatelů jsou připraveny na strojové učení. To znamená, že jsou opatřeny poznámkami a jsou dodávány se zárukou kvality. |

| Buďte opatrní ohledně licencování a omezení souladu s datovými sadami, které stahujete. | Interní zdroje se stávají riskantními, pokud máte omezený čas na uvedení svého produktu na trh. | Můžete definovat své termíny a podle toho si nechat doručit datové sady. |

Jak špatná data ovlivňují vaše ambice v oblasti umělé inteligence?

Vyjmenovali jsme tři nejběžnější zdroje dat z toho důvodu, abyste měli představu, jak přistupovat ke sběru dat a získávání zdrojů. V tuto chvíli je však nezbytné také pochopit, že vaše rozhodnutí může vždy rozhodnout o osudu vašeho řešení AI.

Podobně jako mohou vysoce kvalitní tréninková data AI pomoci vašemu modelu poskytovat přesné a včasné výsledky, mohou špatná tréninková data také narušit vaše modely AI, zkreslit výsledky, zavést zkreslení a nabídnout další nežádoucí důsledky.

Ale proč se to děje? Neměla by nějaká data trénovat a optimalizovat váš model AI? Upřímně, ne. Pojďme tomu rozumět dále.

Špatná data – co to je?

Rozdíl mezi nestrukturovanými a špatnými daty je ten, že přehledy o nestrukturovaných datech jsou všude. Ale v podstatě by mohly být užitečné bez ohledu na to. Pokud by datoví vědci věnovali více času, byli by stále schopni extrahovat relevantní informace z nestrukturovaných datových sad. To však není případ špatných dat. Tyto datové sady neobsahují žádné/omezené poznatky nebo informace, které jsou cenné nebo relevantní pro váš projekt AI nebo jeho školicí účely.

Když tedy získáváte své datové sady z volných zdrojů nebo máte volně vytvořené interní datové kontaktní body, je vysoce pravděpodobné, že si stáhnete nebo vygenerujete špatná data. Když vaši vědci pracují na špatných datech, nejen že plýtváte lidskými hodinami, ale také tlačíte na uvedení vašeho produktu na trh.

Pokud stále nemáte jasno v tom, co mohou špatná data udělat s vašimi ambicemi, zde je stručný seznam:

- Strávíte nespočet hodin získáváním špatných dat a plýtváte hodinami, úsilím a penězi na zdroje.

- Špatná data vám mohou způsobit právní problémy, pokud si toho nevšimnete, a mohou snížit efektivitu vaší AI

modely. - Když spustíte svůj produkt vyškolený na špatných datech, ovlivní to uživatelský dojem

- Špatná data by mohla způsobit, že výsledky a závěry budou zkreslené, což by mohlo přinést další negativní reakce.

Pokud se tedy ptáte, zda na to existuje řešení, ve skutečnosti existuje.

Poskytovatelé AI Training Data na záchranu

Jediné, co musíte udělat, je vzít data a vycvičit své modely AI k dokonalosti. Díky tomu jsme si jisti, že vaše další otázka se týká výdajů spojených se spoluprací s dodavateli dat. Chápeme, že někteří z vás již pracují na mentálním rozpočtu a přesně tam míříme také příště.

Faktory, které je třeba vzít v úvahu při vymýšlení efektivního rozpočtu pro váš projekt sběru dat

Školení AI je systematický přístup, a proto se rozpočtování stává jeho nedílnou součástí. Faktory, jako je návratnost investic, přesnost výsledků, školicí metodiky a další, by měly být zváženy předtím, než investujete obrovské množství peněz do vývoje AI. Mnoho projektových manažerů nebo majitelů firem v této fázi tápe. Dělají unáhlená rozhodnutí, která přinášejí nevratné změny v procesu vývoje jejich produktů, což je nakonec nutí utrácet více.

Tato část vám však poskytne ty správné poznatky. Když sedíte a pracujete na rozpočtu na školení AI, jsou nevyhnutelné tři věci nebo faktory.

Podívejme se na každou podrobně.

Objem dat, který potřebujete

Celou dobu jsme říkali, že účinnost a přesnost vašeho modelu AI závisí na tom, jak moc je trénovaný. To znamená, že čím větší objem datových sad, tím více učení. Ale to je velmi vágní. Abychom tuto představu vyčíslili, Dimensional Research zveřejnil zprávu, která odhalila, že podniky potřebují minimálně 100,000 XNUMX vzorových datových sad pro trénování svých modelů AI.

Pod pojmem 100,000 100,000 datových sad rozumíme XNUMX XNUMX kvalitních a relevantních datových sad. Tyto datové sady by měly mít všechny základní atributy, anotace a poznatky potřebné pro vaše algoritmy a modely strojového učení ke zpracování informací a provádění zamýšlených úkolů.

S tímto obecným pravidlem dále pochopíme, že objem dat, který potřebujete, závisí také na dalším složitém faktoru, kterým je případ použití vaší firmy. O tom, kolik dat potřebujete, také rozhoduje to, co se svým produktem nebo řešením zamýšlíte udělat. Například firma vytvářející modul doporučení by měla jiné požadavky na objem dat než společnost, která buduje chatbota.

Cenová strategie dat

Až dokončíte finalizaci toho, kolik dat skutečně potřebujete, musíte dále pracovat na strategii stanovení cen za data. Jednoduše to znamená, jak byste platili za datové sady, které si pořídíte nebo vytvoříte.

Obecně se jedná o běžné cenové strategie používané na trhu:

| Datový typ | Cenová strategie |

|---|---|

| Cena za jeden obrazový soubor | |

| Cena za sekundu, minutu, hodinu nebo individuální snímek | |

| Cena za sekundu, minutu nebo hodinu | |

| Cena za slovo nebo větu |

Ale počkej. To je opět pravidlo. Skutečné náklady na pořízení datových sad také závisí na faktorech, jako jsou:

- Jedinečný segment trhu, demografie nebo geografie, odkud je třeba získávat datové sady

- Složitost vašeho případu použití

- Kolik dat potřebujete?

- Váš čas na trh

- Jakékoli požadavky na míru a další

Pokud budete pozorovat, budete vědět, že náklady na získání velkého množství obrázků pro váš projekt AI mohou být nižší, ale pokud máte příliš mnoho specifikací, ceny mohou vystřelit nahoru.

Vaše strategie získávání zdrojů

To je ošemetné. Jak jste viděli, existují různé způsoby, jak generovat nebo získávat data pro vaše modely AI. Zdravý rozum by diktoval, že bezplatné zdroje jsou nejlepší, protože si můžete stáhnout požadované objemy datových sad zdarma bez jakýchkoli komplikací.

Právě teď by se také zdálo, že placené zdroje jsou příliš drahé. Ale to je místo, kde se přidává vrstva komplikací. Když získáváte datové sady z volných zdrojů, strávíte další množství času a úsilí čištěním datových sad, jejich kompilací do formátu specifického pro vaši firmu a následným individuálním přidáváním poznámek. V tomto procesu vám vznikají provozní náklady.

U placených zdrojů je platba jednorázová a navíc získáte strojově připravené datové sady v čase, který požadujete. Cenová výhodnost je zde velmi subjektivní. Pokud máte pocit, že byste si mohli dovolit trávit čas anotováním bezplatných datových sad, můžete odpovídajícím způsobem rozpočet. A pokud se domníváte, že vaše konkurence je nelítostná a s omezeným časem uvedení na trh, můžete na trhu vytvořit vlnový efekt, měli byste preferovat placené zdroje.

Rozpočtování je o rozčlenění specifik a jasném definování každého fragmentu. Tyto tři faktory by vám měly sloužit jako plán pro váš budoucí rozpočtový proces školení AI.

Šetříte na výdajích díky vlastnímu sběru dat?

Víme, že stále váháte s placenými zdroji, a proto tato sekce vyčistí vaši skepsi vůči nim a osvětlí skryté náklady spojené s generováním vlastních dat.

Je pořízení interních dat drahé?

Ano to je!

Nyní je zde podrobná odpověď. Výdaj je cokoliv, co utratíte. Při diskuzi o bezplatných zdrojích jsme odhalili, že v procesu utrácíte peníze, čas a úsilí. To platí i pro vnitropodnikový sběr dat.

Nakonec byste skončili utrácením za platby svým zaměstnancům, datovým vědcům, anotátorům, profesionálům v oblasti zajišťování kvality a dalším. Budete také utrácet za předplatné nástrojů pro anotaci a

náklady na údržbu CMS, CRM a další infrastruktury.

Kromě toho musí mít datové sady problémy se zkreslením a přesností, které je třeba ručně roztřídit. A pokud máte problém s opotřebováním ve svém tréninkovém datovém týmu AI, budete muset utrácet za nábor nových členů, orientovat je ve vašich procesech, trénovat je k používání vašich nástrojů a další.

Skončíte tak, že utratíte více, než kolik byste nakonec vydělali v dlouhodobém horizontu. Existují také výdaje na anotaci. V každém daném okamžiku jsou celkové náklady vynaložené na práci s interními daty:

Vzniklé náklady = počet anotátorů * Cena za anotátora + náklady na platformu

Pokud je váš kalendář školení AI naplánován na měsíce, představte si výdaje, které byste neustále vynakládali. Je to tedy ideální řešení pro získávání dat nebo existuje nějaká alternativa?

Výhody end-to-end poskytovatele služeb sběru dat AI

Existuje spolehlivé řešení tohoto problému a existují lepší a levnější způsoby, jak získat tréninková data pro vaše modely AI. Říkáme jim školící poskytovatelé datových služeb nebo prodejci dat.

Jsou to firmy jako Shaip, které se specializují na poskytování vysoce kvalitních datových sad na základě vašich jedinečných potřeb a požadavků. Odstraňují všechny potíže, kterým čelíte při shromažďování dat, jako je získávání relevantních datových sad, jejich čištění, kompilace a poznámky a další, a umožňují vám soustředit se pouze na optimalizaci vašich modelů a algoritmů umělé inteligence. Díky spolupráci s dodavateli dat se soustředíte na věci, na kterých záleží, a na ty, které máte pod kontrolou.

Kromě toho také odstraníte všechny potíže spojené se získáváním datových sad z volných a interních zdrojů. Abyste lépe porozuměli výhodám koncových poskytovatelů dat, zde je stručný seznam:

- Poskytovatelé školicích datových služeb zcela rozumí vašemu segmentu trhu, případům použití, demografickým údajům a dalším specifikům, aby vám přinesli ta nejrelevantnější data pro váš model AI.

- Mají schopnost získat různé datové sady, které považují za vhodné pro váš projekt, jako jsou obrázky, videa, text, zvukové soubory nebo všechny tyto.

- Dodavatelé dat čistí data, strukturují je a označují je atributy a poznatky, které stroje a algoritmy potřebují k naučení a zpracování. Jedná se o ruční práci, která vyžaduje pečlivou pozornost k detailům a času.

- Máte odborníky na dané téma, kteří se starají o anotaci zásadních informací. Pokud je například váš případ použití produktu v oblasti zdravotnictví, nemůžete si jej nechat opatřit poznámkami od nezdravotnického odborníka a očekávat přesné výsledky. U prodejců dat tomu tak není. Spolupracují s malými a středními podniky a zajišťují, aby vaše digitální zobrazovací data byla řádně anotována průmyslovými veterány.

- Postarají se také o deidentifikaci dat a dodržují HIPAA nebo jiné požadavky a protokoly specifické pro dané odvětví, takže se vyhnete jakýmkoli právním komplikacím.

- Dodavatelé dat neúnavně pracují na odstranění zkreslení ze svých datových sad, aby vám zajistili objektivní výsledky a závěry.

- Dostanete také nejnovější datové sady ve vašem výklenku, takže vaše modely AI budou optimalizovány pro optimální efektivitu.

- Také se s nimi snadno pracuje. Mohou jim být například sděleny náhlé změny v požadavcích na data a oni by bez problémů získali vhodná data na základě aktualizovaných potřeb.

Pevně věříme, že s těmito faktory nyní chápete, jak nákladově efektivní a jednoduchá je spolupráce s poskytovateli školicích dat. S tímto porozuměním zjistíme, jak byste si mohli vybrat nejideálnějšího dodavatele dat pro svůj projekt AI.

Získávání relevantních datových sad

Pochopte svůj trh, případy použití, demografické údaje, abyste získali nejnovější datové sady, ať už se jedná o obrázky, videa, text nebo zvuk.

Vyčistěte relevantní data

Strukturujte a označujte data pomocí atributů a přehledů, kterým stroje a algoritmy rozumí.

Předpojatost dat

Odstraňte zkreslení datových sad a zajistěte, abyste měli objektivní výsledky a závěry.

Datová anotace

O anotaci zásadních informací se starají odborníci z konkrétních oblastí.

De-identifikace dat

Dodržujte zákony HIPAA, GDPR nebo jiné předpisy a protokoly specifické pro dané odvětví, abyste odstranili právní složitosti.

Jak vybrat správnou společnost pro sběr dat AI

Výběr společnosti pro sběr dat AI není tak komplikovaný ani časově náročný jako sběr dat z volných zdrojů. Existuje jen několik jednoduchých faktorů, které musíte zvážit a poté si potřást rukou pro spolupráci.

Když začínáte hledat dodavatele dat, předpokládáme, že jste postupovali a zvažovali vše, o čem jsme dosud diskutovali. Zde je však rychlá rekapitulace:

- Máte na mysli dobře definovaný případ použití

- Váš segment trhu a požadavky na data jsou jasně stanoveny

- Váš rozpočet je na místě

- A máte představu o objemu dat, který potřebujete

Po zaškrtnutí těchto položek pochopíme, jak můžete hledat ideálního poskytovatele datových služeb pro trénink.

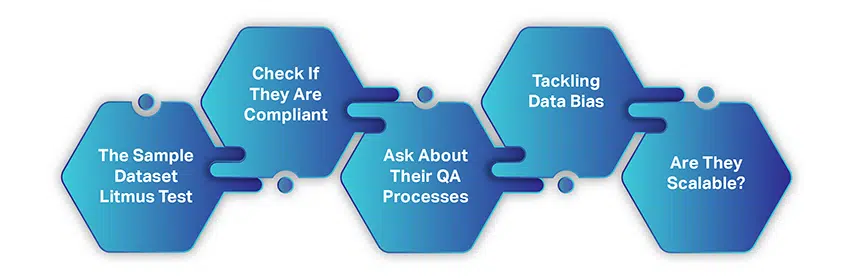

Vzorový lakmusový test datové sady

Před podpisem dlouhodobé smlouvy je vždy dobré podrobně porozumět dodavateli dat. Začněte tedy spolupráci s požadavkem na vzorovou datovou sadu, za kterou zaplatíte.

Může se jednat o malý objem datové sady k posouzení, zda pochopili vaše požadavky, zda mají zavedeny správné strategie nákupu, postupy spolupráce, transparentnost a další. Vzhledem k tomu, že byste v tomto okamžiku byli v kontaktu s více dodavateli, pomůže vám to ušetřit čas při rozhodování o poskytovateli a dokončit rozhodnutí, kdo bude nakonec lépe vyhovovat vašim potřebám.

Zkontrolujte, zda jsou v souladu

Ve výchozím nastavení většina poskytovatelů školicích datových služeb splňuje všechny regulační požadavky a protokoly. Pro jistotu se však zeptejte na jejich dodržování a zásady a poté zúžte svůj výběr.

Zeptejte se na jejich procesy kontroly kvality

Samotný proces sběru dat je systematický a vrstvený. Existuje lineární metodika, která je implementována. Chcete-li získat představu o tom, jak fungují, zeptejte se na jejich procesy kontroly kvality a zeptejte se, zda datové sady, které získávají a anotují, procházejí kontrolami kvality a audity. To vám dá

představu o tom, zda jsou konečné výstupy, které obdržíte, připraveny pro stroj.

Řešení zkreslení dat

Pouze informovaný zákazník by se zeptal na zkreslení v trénovacích datových sadách. Když mluvíte s dodavateli školicích dat, mluvte o zkreslení dat a o tom, jak se jim daří eliminovat zkreslení v souborech dat, které generují nebo pořizují. I když je selský rozum, že je obtížné zcela eliminovat zaujatost, stále můžete znát osvědčené postupy, které dodržují, aby zaujatost udržely na uzdě.

Jsou škálovatelné?

Jednorázové dodávky jsou dobré. Dlouhodobé výsledky jsou lepší. Nejlepší spolupráce jsou však ty, které podporují vaše obchodní vize a současně škálují jejich výsledky s vaším růstem

požadavky.

Diskutujte tedy, zda dodavatelé, se kterými mluvíte, mohou v případě potřeby rozšířit objem dat. A pokud mohou, jak se podle toho změní cenová strategie.

Proč investovat do čističky vzduchu?

Chcete znát zkratku k nalezení nejlepšího poskytovatele školicích dat AI? Kontaktujte nás. Přeskočte všechny tyto zdlouhavé procesy a pracujte s námi pro ty nejkvalitnější a nejpřesnější datové sady pro vaše modely AI.

Zaškrtneme všechna políčka, o kterých jsme dosud diskutovali. Jako průkopník v tomto prostoru víme, co je potřeba k sestavení a škálování modelu umělé inteligence a jak jsou data středobodem všeho.

Také věříme, že Průvodce kupujícího byl obsáhlý a vynalézavý různými způsoby. Trénink umělé inteligence je komplikovaný, ale s těmito návrhy a doporučeními je můžete učinit méně únavnými. Nakonec je váš produkt jediným prvkem, který z toho všeho bude těžit.

Nesouhlasíš?